在数字化转型的浪潮中,数据已成为企业的核心资产。有效的数据治理是确保数据资产价值最大化的基石,而数据模型管控与数据处理,正是这一基石中两根至关重要的支柱。它们共同定义了数据的形态、流向、质量与应用方式,为企业的数据驱动决策提供坚实保障。

一、数据模型管控:构建清晰的数据蓝图

数据模型是数据的抽象表示,它定义了数据的结构、关系、约束与含义,如同建筑的蓝图。一个科学、统一的数据模型管控方案,能够确保数据在产生、存储、流转和使用过程中的一致性、准确性与可理解性。

1. 管控目标与原则

- 标准化:建立企业级的数据标准与规范,统一业务术语、数据定义、编码规则等,消除部门间的数据孤岛与理解歧义。

- 一致性:确保概念模型、逻辑模型与物理模型在不同系统、不同阶段保持内在逻辑的一致,支撑端到端的数据贯通。

- 可维护性与可扩展性:设计灵活、模块化的模型结构,能够敏捷响应业务变化与技术演进。

- 业务驱动:模型设计需紧密贴合业务流程与业务需求,确保数据能够有效服务于业务目标。

2. 管控流程与组织

- 建立治理组织:成立数据治理委员会或数据架构师团队,负责模型标准的制定、评审、发布与监督执行。

- 全生命周期管理:涵盖模型的需求调研、设计、评审、发布、部署、变更与退役的全过程。建立严格的版本控制和变更管理流程。

- 工具平台支撑:采用专业的数据建模工具(如ERWin, PowerDesigner等)或数据治理平台,实现模型的集中存储、可视化、版本对比与影响分析。

二、数据处理:实现数据价值的引擎

数据处理是指对数据进行采集、清洗、转换、集成、计算与分析等一系列操作,将原始数据转化为可信、可用、有价值的信息和知识。它是在数据模型定义的框架下,让数据“动”起来并产生价值的关键过程。

1. 核心处理环节

- 数据采集与集成:从多源异构系统(如业务系统、IoT设备、外部数据源)中抽取数据,并按照目标模型进行整合,形成统一的数据视图。

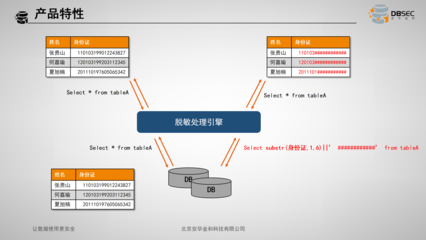

- 数据清洗与质量提升:识别并处理数据中的错误、缺失、不一致与重复等问题,建立数据质量监控规则与闭环改进机制。

- 数据转换与加工:根据业务规则和计算逻辑,对数据进行聚合、关联、衍生等操作,生成指标、标签、特征等增值数据。

- 数据服务与分发:通过API、数据服务层、数据仓库/湖仓一体等平台,将处理好的数据安全、高效地提供给下游的分析、应用与决策系统。

2. 关键技术与架构

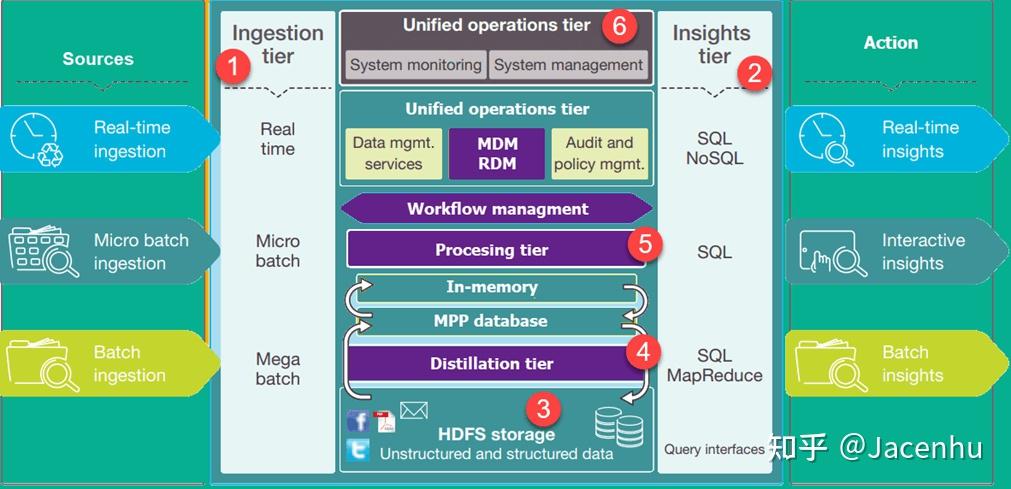

- 批流一体处理:结合批量处理(如Hadoop, Spark)与实时流处理(如Flink, Kafka Streams)能力,满足不同时效性的业务需求。

- 数据管道自动化:利用工作流调度工具(如Airflow, DolphinScheduler)实现数据处理任务的编排、监控与自动化执行。

- 数据血缘与可观测性:建立端到端的数据血缘图谱,清晰追踪数据的来源、处理过程与去向,支持影响分析、根因追溯与合规审计。

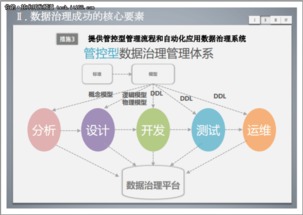

三、协同联动:模型管控与数据处理的融合

数据模型管控与数据处理并非孤立存在,而是紧密耦合、相互促进。

- 模型指导处理:清晰、稳定的数据模型为数据处理提供了准确的目标和路线图。处理流程的设计、转换规则的制定,都必须严格遵循已定义的模型标准,确保产出数据符合预期。

- 处理反馈模型:数据处理过程中暴露的数据质量问题、性能瓶颈或新的业务需求,会反过来推动数据模型的优化与迭代。例如,频繁的跨表关联可能提示需要调整模型设计以提升性能。

- 统一治理平台:理想的数据治理体系应将模型管控(设计、资产目录)与数据处理(质量、血缘、任务调度)能力整合在统一的平台或中台上,实现元数据、数据标准、数据质量、数据安全的联动管理,形成治理闭环。

###

数据模型管控方案与高效的数据处理流程,共同构成了企业数据治理的“任督二脉”。前者构建了清晰、稳定的数据骨架,后者赋予了数据流动与增值的生命力。只有将两者系统性地规划、严谨地执行并持续优化,才能将海量、无序的原始数据,转化为高质量、高可信度、易于使用的战略性资产,最终赋能业务创新与智能决策,在数字竞争中赢得先机。