在数字化浪潮席卷全球的今天,数据已成为驱动企业决策、优化运营和创造价值的核心资产。未经治理的原始数据往往面临着准确性低、一致性差、时效滞后等质量挑战,直接影响了数据分析的可靠性与业务洞察的有效性。此时,数据治理作为一套系统性、持续性的管理体系,便成为了提升数据质量、赋能数据处理流程不可或缺的“利器”。

数据治理:为数据质量奠定坚实基石

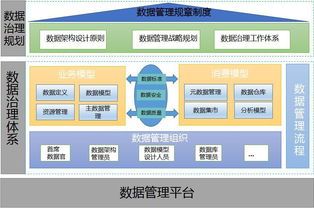

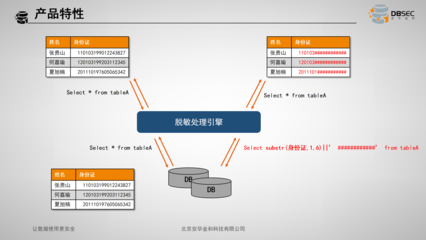

数据治理并非单一的技术活动,而是一个融合了战略、组织、流程与技术的综合性框架。其核心目标在于确保数据的可用性、一致性、完整性、准确性与安全性。通过建立明确的政策、标准、角色与职责,数据治理从源头规范数据的产生、采集、存储与流转。例如,通过定义统一的数据标准(如客户编码规则、产品分类标准),可以从根本上减少数据冗余与歧义;通过建立数据质量监控规则与问责机制,能够及时发现并修复数据中的错误、缺失或不一致问题。这就像为企业的数据资产建立了一套“宪法”与“执法体系”,确保数据在生命周期的各个阶段都处于受控、可信的状态,从而为高质量的数据分析奠定坚实基础。

数据处理:在治理框架下的高效与可靠运行

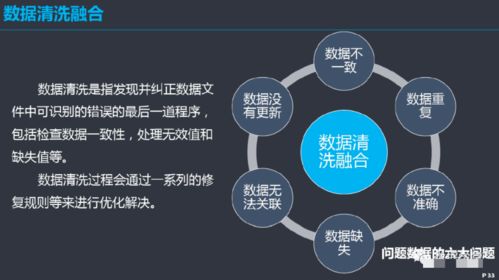

数据处理涵盖了从原始数据到可用信息或知识的整个转换过程,包括数据清洗、集成、转换、分析与可视化等环节。在缺乏有效治理的环境下,数据处理往往陷入“脏数据进,脏数据出”的困境,耗费大量资源进行重复、低效的清洗工作,且结果难以保证。

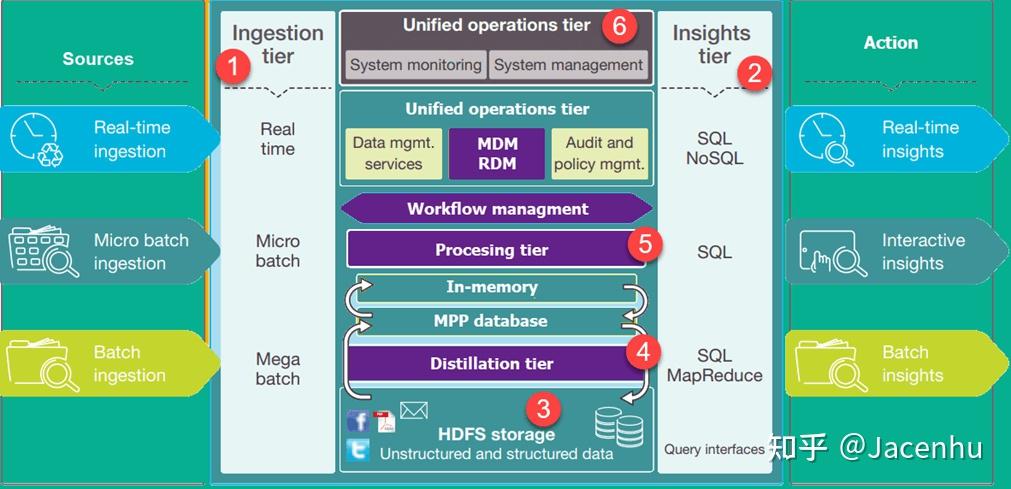

当强有力的数据治理体系就位后,数据处理流程将焕然一新:

- 前置的质量保障:数据在进入处理管道前,已遵循既定的质量标准与规范,显著降低了清洗和修正的复杂度与成本。

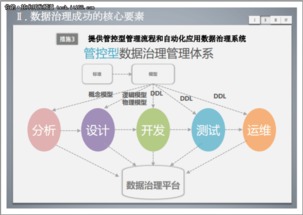

- 流程的标准化与自动化:基于治理定义的标准和规则,数据处理任务(如ETL)可以更加标准化、自动化,提高效率并减少人为错误。

- 可追溯与可信的结果:所有数据处理活动都能在治理框架下追溯其数据血缘,明确数据的来源、变换过程与责任人,极大增强了最终数据产物的可信度与可审计性。

- 赋能高级分析:高质量、定义清晰的数据直接为机器学习、人工智能等高级数据分析应用提供了优质“燃料”,释放更深层次的商业价值。

治理与处理的协同共生:利器之刃

数据治理与数据处理并非先后关系,而是相辅相成、协同共生的循环体系。数据治理为数据处理提供了“轨道”和“交通规则”,确保数据处理高速且安全地驶向目标。数据处理过程中发现的质量问题、效率瓶颈及新需求,又会反过来驱动数据治理策略、标准和流程的持续优化与迭代。例如,在数据分析中频繁发现的某个字段含义模糊问题,会触发数据治理委员会修订该字段的业务定义与技术标准。

结论

总而言之,在数据价值日益凸显的时代,数据治理是提升数据质量不可或缺的顶层设计与管控利器,而高效、可靠的数据处理则是这一利器价值得以实现的关键执行环节。企业只有将数据治理融入组织文化与数据生命周期全过程,让治理引领处理,以处理反馈治理,才能将原始数据真正淬炼为精准、可信的战略资产,从而在激烈的市场竞争中凭借数据驱动决策赢得先机。